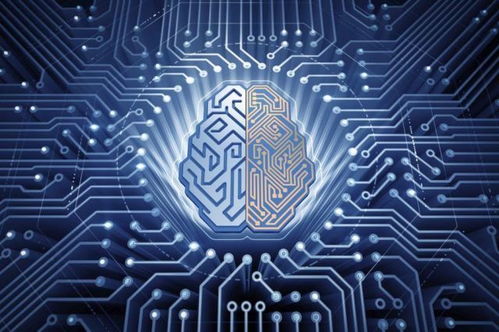

人工智能新算法探索

1. 引言

随着科技的快速发展,人工智能(AI)逐渐成为当今社会最为热门的话题之一。人工智能作为计算机科学的分支,旨在研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统。近年来,深度学习、强化学习、生成对抗网络(GA)、迁移学习等算法的突破性发展,使得人工智能在多个领域取得了显著成果。本文将就人工智能与机器学习基础、深度学习算法、强化学习算法、生成对抗网络(GA)、迁移学习算法、卷积神经网络(C)与循环神经网络(R)、注意力机制算法、预训练语言模型与知识蒸馏、可解释性与公平性、应用领域与挑战等方面进行探讨。

2. 人工智能与机器学习基础

人工智能是机器学习的父集,机器学习是人工智能的一个子集。机器学习是一种通过让机器从数据中学习规律和模式,从而完成特定任务的方法。其核心包括监督学习、无监督学习和强化学习等。

3. 深度学习算法

深度学习是机器学习的一个分支,它基于人工神经网络的结构和功能模拟来实现计算机对人脑的模拟。其中,卷积神经网络(C)和循环神经网络(R)是两种重要的深度学习算法。C在图像处理方面表现出色,而R则擅长处理序列数据,如文本和语音。

4. 强化学习算法

强化学习是一种通过试错学习的机器学习方法。智能体在环境中采取行动,获得奖励或惩罚,从而调整其行为。DeepMid的AlphaGo便采用了强化学习算法,通过自我对弈提升棋艺。

5. 生成对抗网络(GA)

GA是一种生成模型,由两个神经网络组成:生成器和判别器。生成器尝试生成看起来像真实数据的样本,而判别器则尝试区分真实数据和生成数据。两者通过迭代优化,最终使生成器能够生成足以欺骗判别器的样本。GA已被广泛应用于图像生成、视频合成等领域。

6. 迁移学习算法

迁移学习是一种将从一个任务中学到的知识应用到另一个任务的机器学习方法。这使得机器能够在新任务上更快地学习,而无需从头开始。迁移学习对于处理不同但相关的任务非常有用,例如在自然语言处理中的文本分类和情感分析等任务。

7. 卷积神经网络(C)与循环神经网络(R)

C和R是深度学习中最常用的两种神经网络架构。C特别适用于处理图像数据,通过卷积层对图像进行逐层特征提取,最终得到图像的特征表示。R则适用于处理序列数据,如文本和语音。R通过将前一个时间步长的隐藏状态输入到当前时间步长,从而捕捉序列数据中的时间依赖性。长短时记忆网络(LSTM)和门控循环单元(GRU)是R的两个重要变种,它们能够解决传统R存在的长期依赖问题。

8. 注意力机制算法

注意力机制是一种让模型关注输入数据中重要部分的方法。在自然语言处理领域,Trasformer架构中的自注意力机制让模型能够理解输入文本中的语义关系,从而在翻译和语言生成任务中取得突破性成果。

9. 预训练语言模型与知识蒸馏

预训练语言模型(PLM)如BERT和GPT等在大量无标签数据上进行预训练,从而学习语言的内在结构和知识。知识蒸馏是一种将大模型的知识迁移到小模型的方法,从而减少小模型的计算量和提高性能。这两项技术都为自然语言处理领域的许多任务带来了显著改进。

10. 可解释性与公平性

随着AI技术在各个领域的广泛应用,可解释性和公平性成为越来越重要的问题。对于医疗、金融等关键领域,AI系统的决策需要透明且公正。近年来,许多研究致力于提高AI系统的可解释性和公平性,例如通过可解释性模型、公平性算法等来改善AI系统的决策过程。

11. 应用领域与挑战

人工智能的应用领域非常广泛,包括但不限于医疗健康、金融、交通、安防、教育等。在这些领域中,AI技术的应用都为人类带来了巨大的便利和效益。人工智能的发展也面临着诸多挑战,如数据隐私问题、算法安全性问题、计算资源问题等。为了更好地推动AI技术的发展和应用,我们需要持续研究和解决这些问题。